随着科学技术的不断进步和发展,人工智能成为了如今的一大热门方向。拥有高度智慧的人脑,自然而然成为了最好的模仿对象,神经网络的概念也应运而生。

人脑中有860亿个神经元,这被认为是支持我们思考的原因。人脑的神经元由一个细胞体和很多突触组成,能处理并传递各种电信号,依照人脑的神经元结构,人们构建了计算机的神经网络。神经网络由许多具有存储功能的节点构成,类比人脑,我们同样称这些节点为神经元。而神经网络的突触,在计算机模拟中则被抽象表示为具有权重的连接,决定了神经元存储内容的变化及传播方向。

人脑的工作模式,以识别物体为例,由视网膜接收光线并转化为电信号传递给神经元,神经元从中找出颜色、材质等基本信息,最终由大脑给出判定结果,识别出物体的种类。神经网络也同样如此,神经网络主要由输入层、隐含层和输出层组成。由输入层等效视网膜获取相应的信息,并转化为神经网络可理解的内容。隐含层对这些内容进行处理,起特征提取的作用,最终交由输出层得出判定结果。改造这些层的基本结构和处理方式,就产生了不同的神经网络模型,可在不同应用领域起不同的作用。

卷积神经网络CNN是一种采用卷积的方式对图像进行处理的网络结构。卷积神经网络的基本层级结构主要有:输入、输出层、卷积层、ReLU激励层、池化层和全连接层。其中,全连接层主要起分类或回归的作用,由于全连接层容易丢失一些特征信息,且带来冗余。因此,在特定应用场景中,人们丢弃了原本的全连接层,全部采用卷积层进行信息处理,即FCN模型。数据表明,FCN在进行像素级图像处理时,训练结果较好,因此也被广泛应用在各种图像处理方法中。

1.输入层与输出层

顾名思义,输入层与输出层分别起到的是数据接收与结果输出的作用。输入层通常会对接收的原始数据做一定的预处理。

2.卷积层

卷积神经网络中最主要的层自然是卷积层。所谓卷积,是一种利用卷积核进行特征提取的过程。卷积核是指一种带有填充值的权重矩阵,而原始图片经过输入层后会变成灰度或RGB数值填充的矩阵,卷积核在这个输入矩阵上以一定的距离(步长Stride)移动并计算,将两个矩阵中的元素分别点乘并相加,记录每一次计算得到的结果,可得到一个新矩阵。新矩阵能反映出图像的部分特征,因此被称为特征图。训练的过程便是给定数据和标签,使神经网络自动确定卷积核中的填充值。

3.池化层

池化层的主要功能是对特征提取的结果进行简化处理,减少计算量,提高训练速度。常用的池化手段有最大值池化(max-pooling)和平均值池化(mean-pooling)。其工作原理很简单,设定特定大小的池化区域,通常为2*2,在每个池化域内只保留最重要的信息(最大值或平均值),从而缩小特征图,减少计算机负载。

一般来说,通过池化的手段可解决特征提取过程中产生的特定误差。平均值池化可以减小领域大小受限带来的影响,保留更多背景信息,避免出现方差过大的情况;而最大值池化相较于平均池化,更关注纹理信息,能减小因卷积层参数误差导致的均值偏移。因此,两种池化的选择需要结合需求而定,也可结合使用,增加结果的可靠性。

- ReLU激活函数

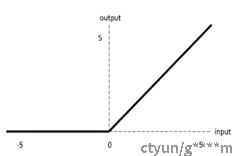

神经网络中,卷积处理相当于矩阵的相乘,每一层输入的都是上层的线性函数,激活函数的引入,可给神经网络引入非线性因素,从而应用到各种非线性模型中。在卷积神经网络中,通常使用修正线性单元(The Rectified Linear Unit,ReLU)作为激活函数。相比于传统的sigmoid函数,具有防止梯度弥散、稀疏激活性和加快计算的特点。其计算公式如式(1)所示,对应的函数图像如图所示。

其中x为输入特征的数值。