一、简介

计算机视觉是人工智能的一个领域,它使计算机能够理解和解释图像或视觉数据。在这个领域中,目前比较知名的是卷积神经网络(Convolutional Neural Networks, CNN),它是计算机视觉中常用的一种深度学习神经网络架构。

当我们谈及机器学习时,人工神经网络常常进入人的视线中,因为它的表现常常是很好的。神经网络常常被用于处理各种数据集,如图像、音频、文本等。不同种类的神经网络服务与不同的领域。对于图像分类这一领域中,我们使用CNN。

常规的人工神经网络通常为三层结构:

输入层:这是我们向模型提供输入的层。此层中的神经元数量等于我们数据中的特征总数(如图像中的像素数量)。

隐藏层:输入层的输入随后被馈送到隐藏层。根据我们的模型和数据大小,可以有许多隐藏层。每个隐藏层可以有不同数量的神经元,这些神经元通常大于特征数量。每层的输出都是通过将前一层的输出与该层的可学习权重进行矩阵乘法计算得出的,然后通过添加可偏置项(bias),然后使用激活函数使网络变为非线性。

输出层:隐藏层的输出随后被馈送到logistic函数(如 sigmoid 或 softmax)中,该函数将每个类的输出转换为每个类的概率分数。

数据被输入到模型中,并从上述步骤中获得每一层的输出,这被称为前向传播(前馈);而后,我们使用损失函数来计算模型的预期结果与实际结果之间的偏差,并将该偏差导入模型中,这被成为方向传播。

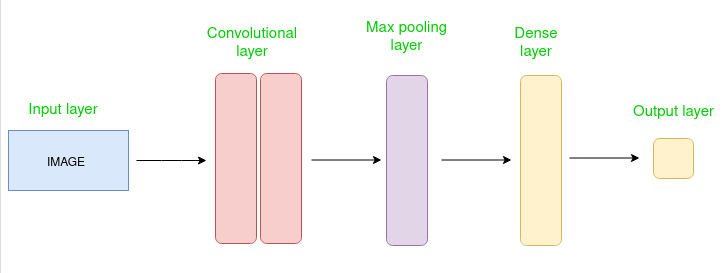

二、CNN架构

CNN由输入层、卷积层、池化层、全连接层等组成。

卷积层在卷积核的帮助下提取输入图像的特征,池化层对图像进行下采样以减少计算量,全连接层进行最终预测。

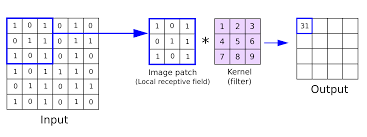

一张图像可以视为若干像素值构成的二维矩阵,卷积核则是一个小型的二维矩阵,用于从像素二维矩阵中提取图像的局部特征。

一个卷积核一般包括核大小(Kernel Size)、步长(Stride)以及填充步数(Padding),我们逐一解释下。

卷积核大小:卷积核定义了卷积的大小范围,在网络中代表感受野的大小,二维卷积核最常见的就是 3*3 的卷积核。一般情况下,卷积核越大,感受野越大,看到的图片信息越多,所获得的全局特征越好。但大的卷积核会导致计算量的暴增,计算性能也会降低。

步长:卷积核的步长代表提取的精度, 步长定义了当卷积核在图像上面进行卷积操作的时候,每次卷积跨越的长度。对于size为2的卷积核,如果step为1,那么相邻步感受野之间就会有重复区域;如果step为2,那么相邻感受野不会重复,也不会有覆盖不到的地方;如果step为3,那么相邻步感受野之间会有一道大小为1颗像素的缝隙,从某种程度来说,这样就遗漏了原图的信息。

填充:卷积核与图像尺寸不匹配,会造成了卷积后的图片和卷积前的图片尺寸不一致,为了避免这种情况,需要先对原始图片做边界填充处理。

由此,我们构建出了卷积层。而后,将卷积层的输出输入到激活函数,可将神经网络非线性化。

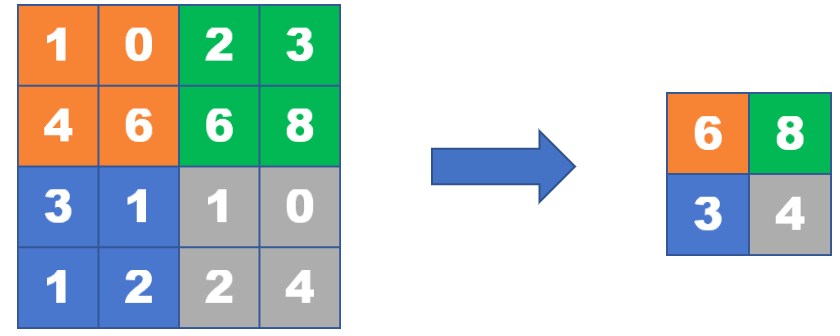

池化层的作用,主要是减少计算量、防止过度拟合。

上面的输出结果会被展开为一维数组,输入到全连接层,在激活函数的帮助下计算出最终的分类。